Xcapit Labs / Privacy

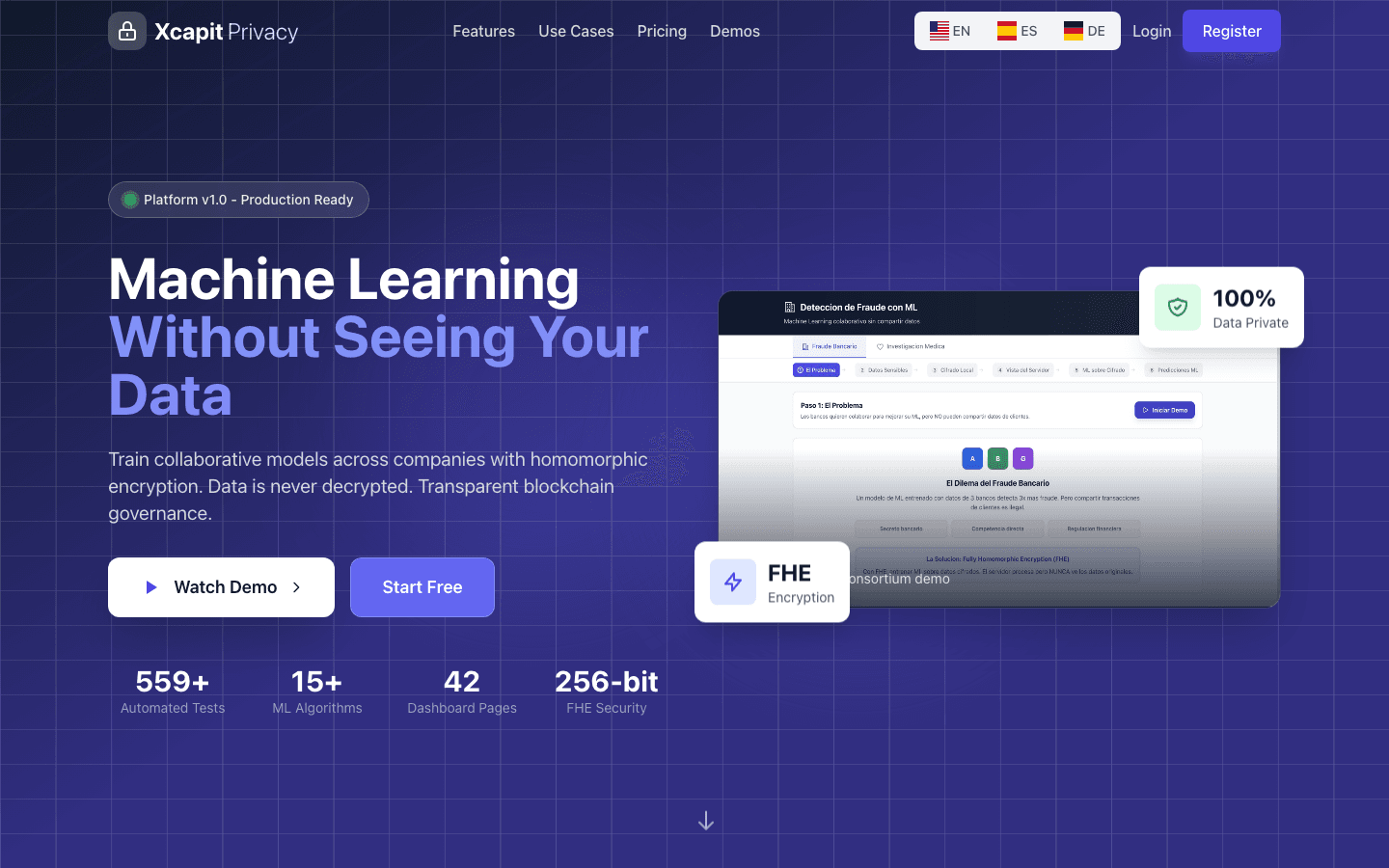

Machine Learning auf Daten, die Verschlüsselt Bleiben

Trainieren Sie KI-Modelle auf sensiblen Daten, ohne sie jemals zu entschlüsseln. Vollständig Homomorphe Verschlüsselung ermöglicht Organisationen die Zusammenarbeit bei Betrugserkennung, medizinischer Forschung und Risikoanalyse — bei vollständigem Schutz ihrer Daten.

Fähigkeiten

Was Privacy Leistet

Vollständig Homomorphe Verschlüsselung

Daten werden mit dem CKKS-Schema über TenSEAL verschlüsselt. Berechnungen erfolgen direkt auf dem Chiffretext — die Plattform sieht nie Klartextdaten, nicht einmal während des Modelltrainings.

Kollaboratives ML-Training

Mehrere Organisationen steuern verschlüsselte Daten zu gemeinsamen Modellen bei. Die Daten jeder Partei bleiben privat, während das Modell aus dem kombinierten Datensatz lernt.

Null Datenexposition

Nicht einmal der Plattformbetreiber kann auf die zugrunde liegenden Daten zugreifen. 256-Bit-Verschlüsselung gewährleistet mathematische Datenschutzgarantien über die gesamte Pipeline.

Blockchain-Governance

Arbitrum-Smart-Contracts verwalten Zugriffskontrolle, Audit-Trails und Modell-Governance. Jede Berechnung wird unveränderlich für die regulatorische Compliance protokolliert.

Automatisierte Testsuite

559+ automatisierte Tests überprüfen Verschlüsselungsintegrität, Modellgenauigkeit auf verschlüsselten Daten und Sicherheitsgrenzen. Kontinuierliches Testen stellt sicher, dass Datenschutzgarantien bestehen bleiben.

Privacy-by-Design-Architektur

Von Grund auf mit Datenschutz als Kernbeschränkung gebaut. Jede Komponente ist darauf ausgelegt, Datenexposition zu minimieren und kryptografische Garantien zu maximieren.

Validierung

Bewiesene Garantien

559+ Automatisierte Tests

Umfassende Testsuite, die Verschlüsselungskorrektheit, Modellgenauigkeit auf Chiffretext, Grenzbedingungen und Sicherheits-Randfälle abdeckt.

15+ ML-Algorithmen

Unterstützung für Klassifikation, Regression, Clustering und Anomalieerkennung — alle auf vollständig verschlüsselten Daten ohne Genauigkeitsverlust.

256-Bit-FHE-Sicherheit

CKKS-Verschlüsselungsschema mit 256-Bit-Sicherheitsniveau. Mathematisch bewiesener Datenschutz, der die regulatorischen Anforderungen von Banken und Gesundheitswesen übertrifft.

3-Seiten-Architektur

Klare Trennung: Data-Owner-Seite für Verschlüsselung und Upload, ML-Engineer-Seite für Modelltraining, Admin-Seite für Governance und Audit.

Unsere Reise

Von der Forschung zur Produktion

Privacy begann als Forschungsprojekt, das die Schnittstelle zwischen homomorpher Verschlüsselung und praktischem Machine Learning erforschte.

Forschungsphase

Erforschung von TenSEAL und CKKS-Schemata für praktische ML-Berechnung auf verschlüsselten Daten. Validiert, dass FHE reale Algorithmen mit akzeptabler Leistung unterstützen kann.

Plattform-Architektur

Entwurf der Drei-Seiten-Architektur, die Data-Owner, ML-Ingenieure und Administratoren trennt. Integration von Arbitrum für unveränderliche Governance und Audit-Trails.

Algorithmus-Suite & Tests

Erweiterung auf 15+ ML-Algorithmen mit 559+ automatisierten Tests. Nachgewiesen, dass verschlüsseltes Training statistisch äquivalente Ergebnisse wie Klartext-Training liefert.

Enterprise-Bereitschaft

Produktionshärtung, Compliance-Dokumentation und Enterprise-Integrationsfähigkeiten. Privacy ist bereit für Organisationen, die bei KI zusammenarbeiten müssen, ohne Daten zu teilen.

Kryptographische Grundlagen

Privacy kombiniert modernste homomorphe Verschlüsselung mit produktionsreifer Infrastruktur.

CKKS-Schema für approximative Arithmetik auf verschlüsselten Gleitkommazahlen. Optimiert für ML-Operationen wie Matrixmultiplikation und Polynomauswertung.

Smart Contracts für Zugriffskontrolle, Berechnungs-Audit-Trails und Modell-Governance. Unveränderliche Aufzeichnung jeder verschlüsselten Operation.

Hochleistungs-API für verschlüsselte Datenoperationen. React-Dashboard für Data-Owner, ML-Ingenieure und Administratoren.

Roadmap

Vision 2026

Privacy entwickelt sich von einer Plattform zu einem Standard für datenschutzbewahrende KI-Zusammenarbeit.

Anwendungsfälle

Wer Nutzt Privacy

Gesundheitsforschung

Krankenhäuser und Forschungseinrichtungen trainieren Diagnosemodelle auf kombinierten Patientendaten ohne Weitergabe medizinischer Unterlagen. Datenschutzkonforme KI für bessere Ergebnisse.

Finanzdienstleistungen

Banken und Fintechs arbeiten bei Betrugserkennungs- und Kreditbewertungsmodellen zusammen, ohne Kundentransaktionsdaten an Wettbewerber weiterzugeben.

Regierung & Öffentlicher Sektor

Öffentliche Behörden analysieren sensible Bürgerdaten — Volkszählung, Steuer, Gesundheit — unter Wahrung der verfassungsmäßigen Datenschutzgarantien.

FAQ

Häufig Gestellte Fragen

Was ist Vollständig Homomorphe Verschlüsselung (FHE)?

FHE ermöglicht Berechnungen direkt auf verschlüsselten Daten ohne vorherige Entschlüsselung. Die Ergebnisse sind nach der Entschlüsselung identisch mit denselben Berechnungen auf Klartext. Die Plattform muss Ihre tatsächlichen Daten nie sehen.

Beeinflusst die Verschlüsselung die Modellgenauigkeit?

Das von Privacy verwendete CKKS-Schema unterstützt approximative Arithmetik, die minimales Rauschen einführt. Unsere 559+ Tests bestätigen, dass verschlüsseltes Training statistisch äquivalente Ergebnisse wie Klartext-Training über alle unterstützten Algorithmen liefert.

Wie erfüllt Privacy Datenvorschriften?

Da Daten während der Verarbeitung nie entschlüsselt werden, bietet Privacy die stärkstmögliche Datenschutzgarantie. Dies übertrifft die Anforderungen der DSGVO, HIPAA und der meisten Datenschutzvorschriften, da der Plattformbetreiber selbst unter Zwang nicht auf die Daten zugreifen kann.

Können wir unsere eigenen ML-Algorithmen verwenden?

Privacy unterstützt 15+ integrierte Algorithmen und bietet ein SDK für die Integration benutzerdefinierter Algorithmen. Jeder Algorithmus, der als polynomiale Operationen ausgedrückt werden kann, ist mit der FHE-Berechnung kompatibel.

Bereit, KI auf privaten Daten freizuschalten?

Ob im Gesundheitswesen, Finanzwesen oder der öffentlichen Verwaltung — Privacy ermöglicht das Training von KI-Modellen ohne Kompromisse bei der Datenvertraulichkeit.