Xcapit Labs / Privacy

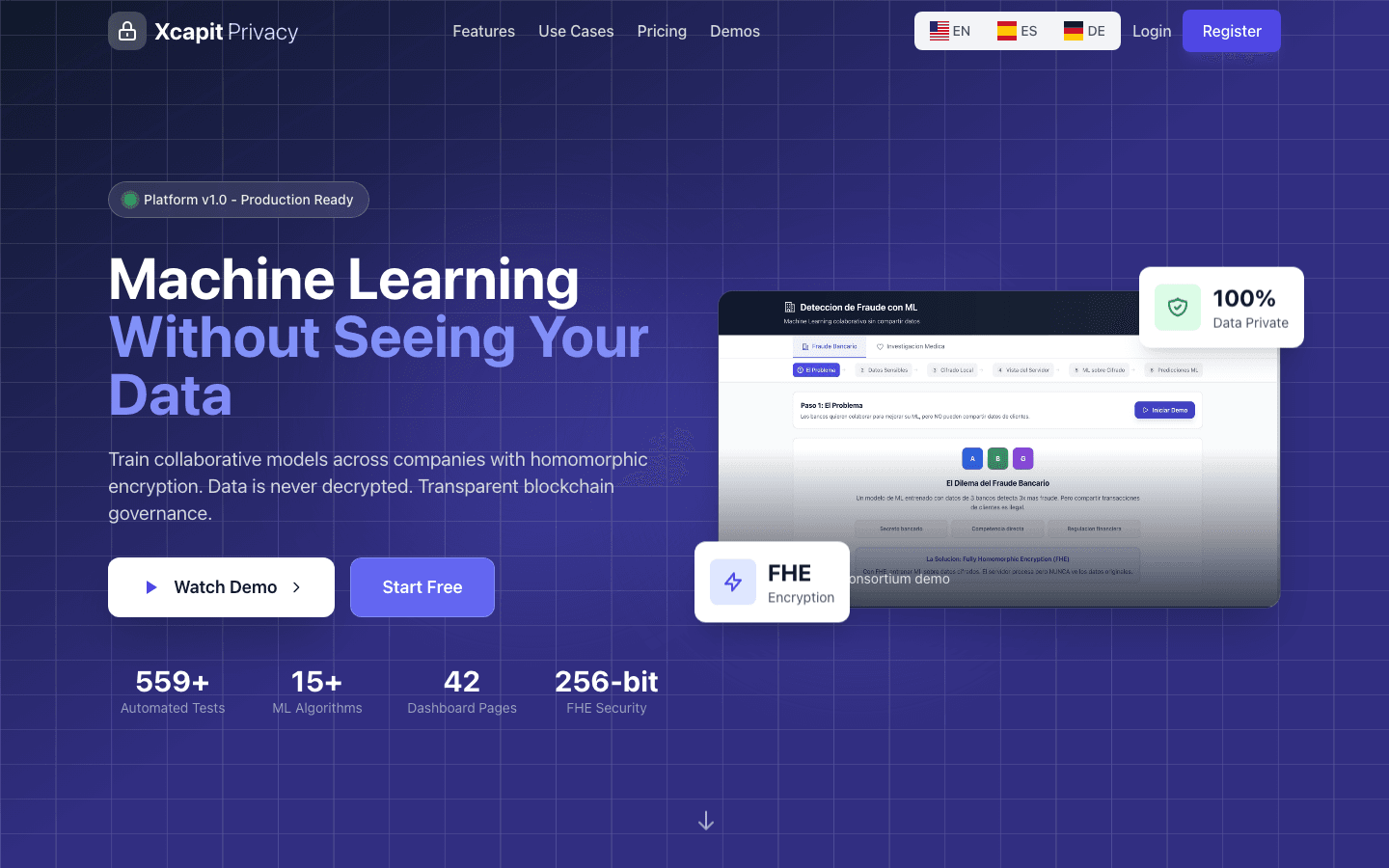

Machine learning sobre datos que permanecen encriptados

Entrená modelos de IA sobre datos sensibles sin nunca desencriptarlos. La Encriptación Completamente Homomórfica permite a las organizaciones colaborar en detección de fraude, investigación médica y análisis de riesgo — manteniendo sus datos completamente privados.

Capacidades

Qué hace Privacy

Encriptación completamente homomórfica

Los datos se encriptan usando el esquema CKKS vía TenSEAL. Las computaciones ocurren directamente sobre el texto cifrado — la plataforma nunca ve datos en claro, ni siquiera durante el entrenamiento del modelo.

Entrenamiento ML colaborativo

Múltiples organizaciones contribuyen datos encriptados a modelos compartidos. Los datos de cada parte permanecen privados mientras el modelo aprende del dataset combinado.

Cero exposición de datos

Ni siquiera el operador de la plataforma puede acceder a los datos subyacentes. La encriptación de 256 bits asegura garantías matemáticas de privacidad a lo largo de todo el pipeline.

Gobernanza Blockchain

Smart contracts de Arbitrum gestionan control de acceso, trazas de auditoría y gobernanza de modelos. Cada computación se registra inmutablemente para compliance regulatorio.

Suite de testing automatizado

559+ tests automatizados verifican integridad de encriptación, precisión del modelo sobre datos encriptados y límites de seguridad. Testing continuo asegura que las garantías de privacidad se mantengan.

Arquitectura Privacy-by-Design

Construida desde cero con la privacidad como restricción central. Cada componente está diseñado para minimizar la exposición de datos y maximizar las garantías criptográficas.

Validación

Garantías comprobadas

559+ tests automatizados

Suite de tests comprehensiva cubriendo correctitud de encriptación, precisión del modelo sobre texto cifrado, condiciones de borde y casos de seguridad extremos.

15+ Algoritmos ML

Soporte para algoritmos de clasificación, regresión, clustering y detección de anomalías — todos operando sobre datos completamente encriptados sin pérdida de precisión.

Seguridad FHE de 256 bits

Esquema de encriptación CKKS con nivel de seguridad de 256 bits. Privacidad matemáticamente comprobada que excede los requisitos regulatorios bancarios y de salud.

Arquitectura de 3 páginas

Separación clara: página de Data Owner para encriptación y carga, página de ML Engineer para entrenamiento de modelos, y página de Admin para gobernanza y auditoría.

Nuestro Recorrido

De la investigación a la producción

Privacy comenzó como un proyecto de investigación explorando la intersección entre encriptación homomórfica y machine learning práctico.

Fase de investigación

Exploramos TenSEAL y esquemas CKKS para computación ML práctica sobre datos encriptados. Validamos que FHE podía soportar algoritmos del mundo real con rendimiento aceptable.

Arquitectura de la plataforma

Diseñamos la arquitectura de tres páginas separando data owners, ingenieros ML y administradores. Integramos Arbitrum para gobernanza y trazas de auditoría inmutables.

Suite de algoritmos y testing

Expandimos a 15+ algoritmos ML con 559+ tests automatizados. Probamos que el entrenamiento encriptado produce resultados estadísticamente equivalentes al entrenamiento en texto plano.

Preparación empresarial

Endurecimiento para producción, documentación de compliance y capacidades de integración empresarial. Privacy está lista para organizaciones que necesitan colaborar en IA sin compartir datos.

Fundamentos criptográficos

Privacy combina encriptación homomórfica de vanguardia con infraestructura de grado productivo.

Esquema CKKS para aritmética aproximada sobre números de punto flotante encriptados. Optimizado para operaciones ML como multiplicación de matrices y evaluación polinomial.

Smart contracts para control de acceso, trazas de auditoría de computación y gobernanza de modelos. Registro inmutable de cada operación encriptada.

API de alto rendimiento para operaciones de datos encriptados. Dashboard React para data owners, ingenieros ML y administradores.

Hoja de ruta

Visión 2026

Privacy está evolucionando de una plataforma a un estándar para colaboración de IA preservando la privacidad.

Casos de uso

Quién usa Privacy

Investigación en salud

Hospitales e instituciones de investigación entrenan modelos de diagnóstico sobre datos de pacientes combinados sin compartir historiales médicos. IA compatible con privacidad para mejores resultados.

Servicios financieros

Bancos y fintechs colaboran en modelos de detección de fraude y scoring crediticio sin exponer datos de transacciones de clientes a competidores.

Gobierno y sector público

Agencias públicas ejecutan analítica sobre datos sensibles de ciudadanos — censo, impositivo, salud — mientras mantienen las garantías constitucionales de privacidad.

Preguntas frecuentes

Preguntas frecuentes

¿Qué es la Encriptación Completamente Homomórfica (FHE)?

FHE permite que se realicen computaciones directamente sobre datos encriptados sin desencriptarlos primero. Los resultados, al desencriptarlos, son idénticos a ejecutar las mismas computaciones sobre texto plano. Esto significa que la plataforma nunca necesita ver tus datos reales.

¿La encriptación afecta la precisión del modelo?

El esquema CKKS usado por Privacy soporta aritmética aproximada, lo que introduce ruido mínimo. Nuestros 559+ tests verifican que el entrenamiento encriptado produce resultados estadísticamente equivalentes al entrenamiento en texto plano en todos los algoritmos soportados.

¿Cómo cumple Privacy con las regulaciones de datos?

Ya que los datos nunca se desencriptan durante el procesamiento, Privacy provee la garantía de privacidad más fuerte posible. Esto excede los requisitos de GDPR, HIPAA y la mayoría de las regulaciones de protección de datos porque el operador de la plataforma no puede acceder a los datos ni siquiera si es obligado.

¿Podemos usar nuestros propios algoritmos ML?

Privacy soporta 15+ algoritmos integrados y provee un SDK para integración de algoritmos personalizados. Cualquier algoritmo que pueda expresarse como operaciones polinomiales es compatible con la computación FHE.

¿Listo para desbloquear IA sobre datos privados?

Ya estés en salud, finanzas o gobierno — Privacy te permite entrenar modelos de IA sin comprometer la confidencialidad de los datos.